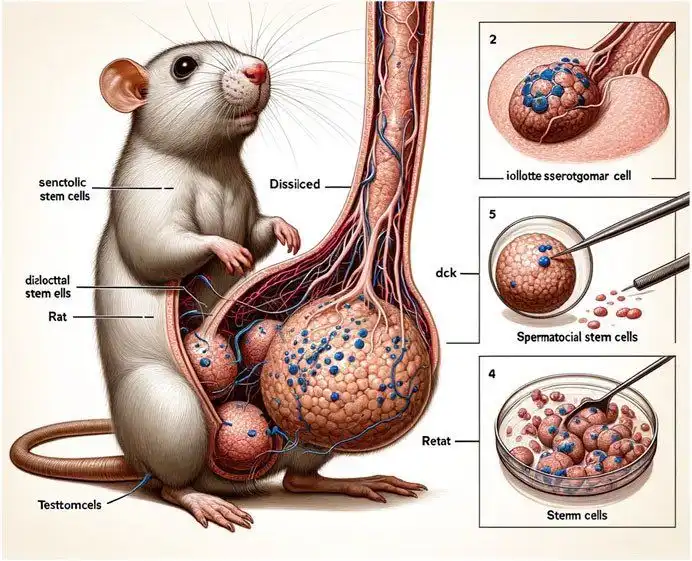

Errores e imprecisiones aparecidos recientemente en revistas científicas, como una imagen de una rata con un pene gigante u otra de una pierna humana con demasiado hueso, revelan el uso cada vez más extendido de la inteligencia artificial (IA) en estas publicaciones y en detrimento de su calidad.

Si los especialistas interrogados por la AFP reconocen el interés de instrumentos como ChatGPT para redactar contenidos, sobre todo en materia de traducción para investigadores cuyo lengua materna no es el inglés, las rectificaciones realizadas recientemente por algunas revistas apuntan a prácticas deshonestas.

A principios de año, una ilustración de una rata con unos órganos genitales sobredimensionados, muy compartida en redes sociales, llevó a la retirada de un estudio publicado en una revista de la editorial universitaria Frontiers, un actor importante en el sector. El mes pasado, otro estudio había sido retirado tras presentar una imagen de una pierna humana donde había más huesos de lo habitual.

Pero más allá de estas imágenes erróneas, la mayor sacudida para el sector procede de ChatGPT, el programa conversacional desarrollado por la empresa estadounidense OpenAI.

En marzo, un artículo publicado por el grupo editorial científico británico Elsevier se hizo viral porque su comienzo era: “Por supuesto, aquí tiene una introducción posible para su tema”, una fórmula típica de las respuestas de ChatGPT.

Estos errores, que escaparon a los controles de los expertos encargados de releer los estudios, son poco frecuentes y probablemente no superarían los filtros de las revistas más prestigiosas, afirmaron varios especialistas.

El empleo de la IA es a menudo difícil de detectar, pero parece que aumenta en la literatura científica. Andrew Gray, un bibliotecario del University College de Londres, ha examinado minuciosamente millones de artículos científicos buscando palabras como “meticuloso”, “complejo” o “loable”, a menudo sobreutilizados por la IA.

Según él, al menos 60,000 artículos se realizaron con ayuda de la IA en 2023, un 1 por ciento de la producción anual. Y en 2024 debe de producirse un “aumento significativo” de estas cifras.

De su parte, la asociación estadounidense Retraction Watch observó un récord de 13,000 retiradas de artículos en el campo científico en 2023, algo jamás visto.

Para Ivan Oransky, uno de los confundadores de esta organización, la IA permite ahora “industrializar” la producción de estudios “fraudulentos” mediante “fábricas” de artículos.

Estos centros de producción en masa generan numerosos artículos de mala calidad, plagiados o falsos, afirma la microbiólogoa neerlandesa especializada en la detección de imágenes trucadas, Elisabeth Bik. Pagadas por investigadores animados a producir más, estas “fábricas” estarían cada año en el origen de un 2 por ciento de los estudios publicados, pero esta cifra “se dispara” por la IA, considera.

Para Oransky, la IA alimenta un “problema apabullante”: la petición insaciable de artículos por parte de editoriales y universidades ejerce una gran presión sobre los investigadores, valorados en función de su producción, lo que crea así un “círculo vicioso”.

En paralelo, las salvaguardias contra estas “fábricas” de estudios son insuficientes. El problema de estos fraudes masivos quedó de relieve tras la compra de la editorial Hindawi por parte de la empresa estadounidense Wiley en 2021, que procedió a retirar unos 11,300 artículos publicados previamente por esa casa.

Para intentar resolver este problema creciente, Wiley implementó un “servicio de detección de fábricas de artículos” que abusan de la IA. Paradójicamente, este programa se basa precisamente en la IA.

Pero la semana pasada, un investigador estadounidense descubrió lo que parece una versión reescrita por ChatGPT de uno de sus propios artículos, publicada en una revista de Wiley. Samuel Payne, profesor de bioinformática en la Universidad Brigham Young de Estados Unidos, indicó que había solicitado en marzo la verificación del estudio.

Después de haberse dado cuenta de que era un “plagio” de su propia obra reescrita por la IA, rechazó aprobar la publicación. Payne se dijo “sorprendido” al constatar que en vez de retirar el artículo, el trabajo plagiado simplemente fue publicado en otra revista. N