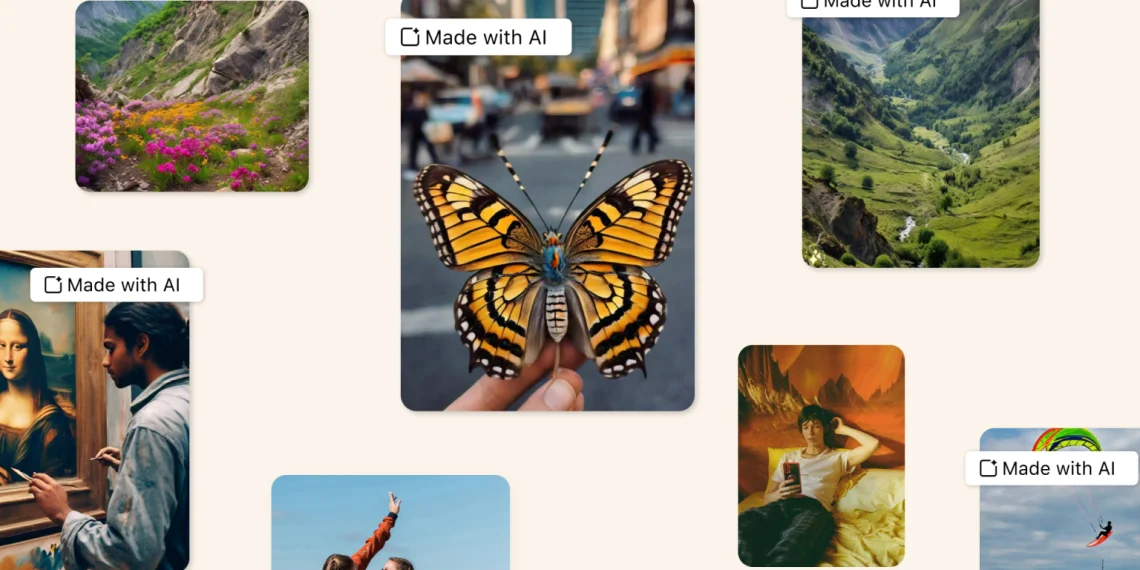

La empresa tecnología Meta, casa matriz de Facebook, Instagram y Threads, anunció este viernes 5 de abril que en mayo dará inicio la identificación de cualquier contenido de imagen o audio generado por inteligencia artificial (IA) con el objetivo de reforzar la lucha contra la desinformación.

“Prevemos empezar a etiquetar en mayo de 2024 contenido generado por inteligencia artificial”, indicó en su blog Monika Bickert, vicepresidenta de contenido de Meta, y añadió que la mención “Made with AI” , que ya se usa en imágenes fotorrealistas, se aplicaría en adelante a “un mayor número de contenidos de video, audio y de imágenes”.

Estos contenidos serán marcados por la plataforma si detecta “indicadores de imagen de inteligencia artificial conformes a las normas de la industria” o si “las personas indican que están subiendo contenidos generados por inteligencia artificial”.

META SE UNE A GOOGLE Y OPENAI EN CONTRA DE LA INTELIGENCIA ARTIFICIAL

Además de las etiquetas visibles, estos contenidos serán marcados por la plataforma con una “marca de agua”, una especie de “tatuaje” digital invisible. “Un filtro es mejor que nada, aunque forzosamente habrá brechas”, explicó a la AFP Nicolas Gaudemet, director de IA del gabinete de análisis francés Onepoint.

Google, Microsoft y OpenAI ya utilizan ese tipo de tecnología. Después de consultar a su junta de supervisión, Meta modificará su forma de tratar los contenidos creados con la inteligencia artificial, ya que ahora considera que “la transparencia y un mayor contexto son la mejor manera de tratar los contenidos manipulados”.

Con ello se evita “el riesgo de restringir innecesariamente la libertad de expresión”. En lugar de eliminarlos, como había estado haciendo hasta ahora, ahora agregará “etiquetas y contexto” a estos contenidos.

TEMOR DE CAOS POLÍTICO

Sin embargo, advirtió Meta, cualquier contenido, ya sea creado por un humano o una inteligencia artificial, que viole sus reglas “contra la interferencia en procesos electorales, la intimidación, el acoso, la violencia (…) o cualquier otra política en nuestras normas comunitarias” será retirado.

Meta reafirmó que confía en su red de “aproximadamente 100 verificadores de datos independientes” para detectar contenidos generados por inteligencia artificial “falsos o engañosos”. La empresa matriz de Facebook había anunciado en febrero su deseo de etiquetar todas las imágenes generadas por inteligencia artificial para luchar contra la desinformación.

Sus competidores Microsoft, Google u OpenAI habían asumido compromisos similares. El temor es que las personas utilicen estas herramientas para sembrar el caos político, especialmente a través de la desinformación o la información errónea. N