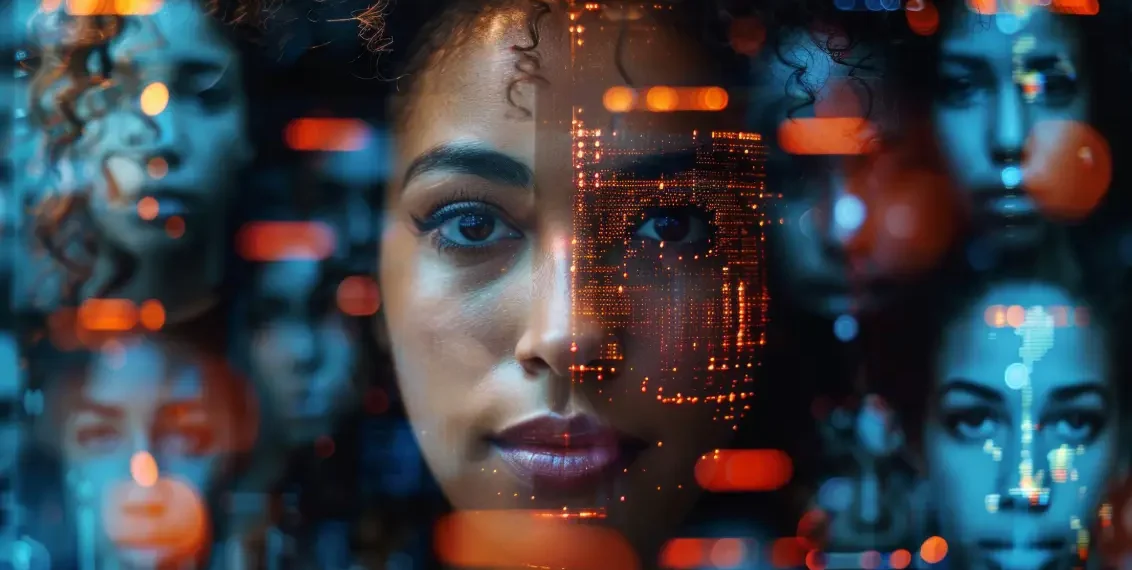

Ante el avance de los deepfakes —archivos de audio, imágenes y videos manipulados o generados con inteligencia artificial (IA)—, el gobierno de Dinamarca presentó una iniciativa con el objetivo de proteger a sus ciudadanos: otorgar derechos de autor sobre el rostro, el cuerpo y la voz de cada persona. Se trataría de una figura similar al copyright, un conjunto de derechos legales que ampara obras originales de autoría, como libros, música, pinturas, películas y software.

El ministro de Cultura, Jakob Engel-Schmidt, anunció la reforma legislativa, que propone modificar la Ley de derechos de autor del país para reconocer que cada individuo es propietario de sus características físicas, su voz y sus gestos. Si el parlamento la aprueba, Dinamarca se convertiría en el primer país en establecer este tipo de protección.

“Los seres humanos pueden ser procesados digitalmente y utilizados de forma indebida para todo tipo de fines y no estoy dispuesto a aceptarlo”, afirmó el ministro.

Conoce más del tema: ¿Una película biográfica sobre Vladimir Putin? La IA lo hace posible

Con esta norma, los ciudadanos daneses tendrían la facultad de exigir la eliminación de contenido publicado sin su consentimiento, en plataformas como TikTok, Facebook e Instagram. El incumplimiento podría derivar en compensaciones económicas para los afectados.

Sin embargo, según el diario La Vanguardia, la legislación no limitaría las parodias ni la sátira, que seguirían permitidas. “Estamos innovando, y si las plataformas no respetan las reglas, tomaremos medidas adicionales”, advirtió Engel-Schmidt.

DINAMARCA CONTRA LAS DEEPFAKES Y EL USO ÉTICO DE LA IA

Se espera que la iniciativa sea presentada formalmente en las próximas semanas y que avance en el proceso legislativo entre finales de 2025 y principios de 2026. Dinamarca, que pronto asumirá la presidencia del Consejo de la Unión Europea, planea aprovechar ese cargo para impulsar una regulación continental sobre el uso ético de la IA.

De acuerdo con el Foro Económico Mundial, que cita una encuesta de 2023, 60 por ciento de las personas dicen estar “muy preocupadas” por los deepfakes, más que por cualquier otro riesgo de la inteligencia artificia para la sociedad.

Uno de los mayores riesgos de este mal uso de la IA está ligado con los ciberdelincuentes, quienes están suplantando a las personas con fines de estafa, pues se ganan la confianza de sus conocidos y logran robarlos.

Ahora lee: Del amor real a los chatbots: la IA perpetúa la violencia y los abusos

El video y audio manipulado con inteligencia artificial para imitar de forma realista a una persona y lograr que diga o haga algo que nunca ocurrió es la nueva modalidad de la estafa en línea. Su alcance no es menor, pues una encuesta de la empresa de ciberseguridad Kaspersky reveló que 72 por ciento de los encuestados no sabe qué es un deepfake y 62 por ciento por ciento asegura que tampoco sabe cómo reconocer un contenido de este tipo. N